Rachel Hu, KDD 2024 konferansında sunum yapıyor

Rachel Hu, KDD 2024 konferansında sunum yapıyor

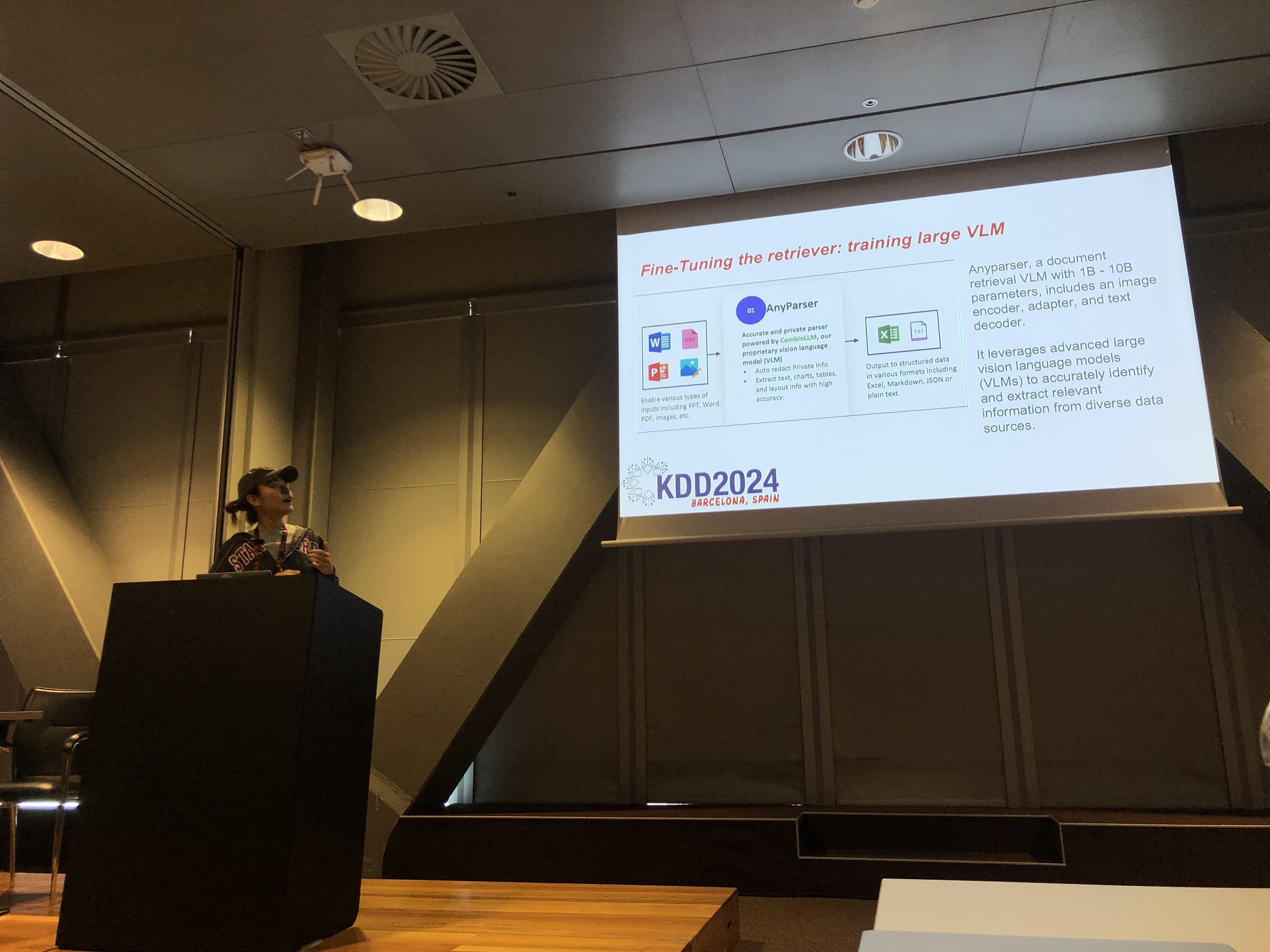

KDD 2024 konferansında, Rachel Hu, CambioML'in Kurucu Ortağı ve CEO'su, alan spesifik uygulamalar için Büyük Dil Modelleri (LLM'ler) optimizasyonu üzerine kapsamlı bir eğitim sundu. Bu sunuma eşlik eden diğer sunucular ise José Cassio dos Santos Junior (Amazon), Richard Song (Epsilla) ve Yunfei Bai (Amazon) oldu. Oturum, Retrieval Augmented Generation (RAG) ve LLM İnce Ayarı gibi iki kritik teknik hakkında derinlemesine bilgiler sundu. Bu yöntemler, LLM'lerin özel alanlarda performansını artırmak için gereklidir ve geliştiricilerin belirli görevler için daha etkili ve doğru modeller oluşturmasına olanak tanır.

RAG'ı Anlamak: LLM Yeteneklerini Genişletmek

Retrieval Augmented Generation (RAG), LLM'lerin dış bilgi kaynaklarıyla entegrasyonunu sağlayarak yeteneklerini genişleten güçlü bir yaklaşımdır. Bu teknik, LLM'lerin kapsamlı yeniden eğitim gerektirmeden belirli alan bilgisine dayalı yanıtlar üretmesini sağlar. RAG, iç bilgi kaynaklarını veya diğer özel kaynakları kullanması gereken organizasyonlar için özellikle faydalıdır ve LLM performansını maliyet etkin ve zaman verimli bir şekilde artırmanın bir yolunu sunar.

İnce Ayar: Modelleri Hassasiyet için Özelleştirmek

LLM İnce Ayarı, modelin ağırlıklarını alan spesifik verilerle ayarlamayı içerir ve bu sayede model, ön eğitim aşamasında dahil edilmeyen yeni, kapsamlı bilgileri sistematik olarak öğrenebilir. Bu yaklaşım, yüksek doğruluk gerektiren görevler için esastır ve genel amaçlı modellerin yetersiz kaldığı alanlarda özellikle etkilidir. İnce Ayar, bir LLM'yi karmaşık, alan spesifik görevleri hassasiyetle yerine getirebilen son derece özel bir araca dönüştürebilir.

RAG ve İnce Ayarı Birleştirerek Optimal Sonuçlar Elde Etmek

Eğitim, RAG ve İnce Ayar'ın birleştirilmesinin LLM uygulamaları için sağlam bir mimari oluşturabileceğini keşfetti. Bu iki yaklaşımı entegre ederek, geliştiriciler en ilgili dış bilgileri erişebilen ve alan spesifik verilerden öğrenebilen modeller oluşturabilir. Bu hibrit yaklaşım, metin üretiminden karmaşık soru-cevap senaryolarına kadar geniş bir yelpazede alan spesifik görevleri yerine getirebilen hem çok yönlü hem de son derece doğru modellerin oluşturulmasına olanak tanır.

Uygulamalı Laboratuvarlar: RAG ve İnce Ayar'ın Pratik Uygulamaları

Rachel'ın eğitiminde önemli bir bölüm, katılımcıların RAG ve İnce Ayarlı LLM mimarilerini optimize etmek için gelişmiş teknikleri keşfettiği uygulamalı laboratuvarlara ayrıldı. Laboratuvarlar, aşağıdaki konuları kapsadı:

-

Gelişmiş RAG Teknikleri: RAG çıktılarının doğruluğunu ve alaka düzeyini artırmak için çok aşamalı optimizasyon stratejileri gösterildi. Bu, ön-geri alma, geri alma ve sonrası geri alma optimizasyonunu, ayrıca daha ince akıl yürütme için bilgi grafiklerinin ve çoklu belge analizinin yenilikçi kullanımını içeriyordu.

-

LLM'leri İnce Ayar: Katılımcılar, alan spesifik veri setleri kullanarak küçük bir LLM'yi ince ayar yapma sürecine katıldılar. Laboratuvar, insan ve AI geri bildirimlerini entegre ederek özel görevlerde üstün performans elde etmek için sürekli ince ayar sürecini vurguladı.

-

Karşılaştırma ve Değerlendirme: Son laboratuvar, RAG, İnce Ayar ve bunların birleşik yaklaşımının çeşitli görevlerdeki performansını karşılaştırmaya odaklandı. Bu, geliştiricilerin belirli ihtiyaçları için en maliyet etkin ve verimli yöntemi seçmelerine yardımcı olmak için detaylı bir ROI analizi içeriyordu.

Alan Spesifik LLM Geliştirme için En İyi Uygulamalar

Eğitim, RAG ve İnce Ayar'ı gerçek dünya uygulamalarında uygulamak için en iyi uygulamalar seti ile sona erdi. RAG'ın esnekliği ile İnce Ayar'ın hassasiyeti arasındaki ticaretin önemini vurgulayarak, katılımcıların sürekli deney yapmaları ve karşılaştırmalar yapmaları teşvik edildi. Bu yaklaşım, performans ve maliyet etkinliği kriterlerinin karşılanmasını sağlar ve geliştiricilerin alan spesifik görevler için LLM mimarilerini etkili bir şekilde optimize etmelerine olanak tanır.

Eğitimin içeriği ve uygulamalı laboratuvarlar hakkında daha ayrıntılı bir genel bakış için lütfen bu makaleye ve bu sunuma başvurun.